高斯-马尔可夫定理

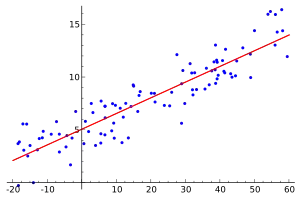

在统计学中,高斯-马尔可夫定理 (Gauss-Markov Theorem) 陈述的是:在线性回归模型中,如果误差满足零均值、同質變異數且互不相关,则回归系数的最佳线性无偏估计(BLUE, Best Linear unbiased estimator)就是普通最小二乘法估计。

- 这里最佳的意思是指相较于其他估计量有更小方差的估计量,同时把对估计量的寻找限制在所有可能的线性无偏估计量中。

- 值得注意的是这里不需要假定误差满足独立同分布(iid)或正态分布,而仅需要满足零均值、不相关及同質變異數这三个稍弱的条件。

| 统计学系列条目 |

| 迴歸分析 |

|---|

|

| 模型 |

|

|

| 估计 |

|

| 背景 |

|

表述

简单(一元)线性回归模型

对于简单(一元)线性回归模型,

其中和是非随机但不能观测到的参数,是非随机且可观测到的一般变量,是不可观测的随机变量,或称为随机误差或噪音,因此是可观测的随机变量。

高斯-马尔可夫定理的假设条件是:

- ,(零均值),

- ,(同方差),

- ,(不相关)。

则对和的最佳线性无偏估计为,

多元线性回归模型

对于多元线性回归模型,

- ,

使用矩阵形式,线性回归模型可简化记为,其中采用了以下记号:

(观测值向量,Vector of Responses),

(设计矩阵,Design Matrix),

(参数向量,Vector of Parameters),

(随机误差向量,Vectors of Error)。

高斯-马尔可夫定理的假设条件是:

- ,(零均值),

- ,(同方差且不相关),其中为n阶单位矩阵(Identity Matrix)。

则对的最佳线性无偏估计为

证明

首先,注意的是这里数据是而非,我们希望找到对于的线性估计量,记作

其中,,和分别是,,和矩阵。

根据零均值假设所得,

其次,我们同时限制寻找的估计量为无偏的估计量,即要求,因此有

- (零矩阵),

参见

外部連結

- Earliest Known Uses of Some of the Words of Mathematics: G (brief history and explanation of its name)

- Proof of the Gauss Markov theorem for multiple linear regression (makes use of matrix algebra)

- A Proof of the Gauss Markov theorem using geometry

This article is issued from Wikipedia. The text is licensed under Creative Commons - Attribution - Sharealike. Additional terms may apply for the media files.